今回紹介するのは、Nicky Reinertさんが書いた「Why I Cancelled Claude: Token Issues, Declining Quality, and Poor Support」という記事です。

ざっくり言うと、Claude Codeをしばらく使ってみたものの、トークン制限の挙動がわかりにくく、サポートも頼りにならず、結果として解約したという体験談です。

ここでいう Claude は、Anthropic社のAIサービスです。ChatGPTの仲間みたいなものだと思えば大きく外れていません。

Claude Code は、そのClaudeをコード作業に使うための機能です。つまり、プログラミングを手伝ってくれるAIですね。

著者はかなり長く開発をしてきた人で、AIも3年前から仕事に取り入れてきたとのこと。なので、単なる「AIに期待しすぎた人の愚痴」と切り捨てるには、少し惜しい内容です。むしろ、実務でAIを使っている人ならではの不満が詰まっています。これは面白い。

記事の前半では、著者はClaude Codeをかなり好意的に見ています。

つまり、最初の印象はかなりよかったわけです。

ここは重要で、最初からダメだったわけではないんですよね。むしろ「期待させるだけ期待させてから、じわじわ不満が積み上がった」というタイプの話です。こういうの、ユーザー体験としていちばんつらいと思います。

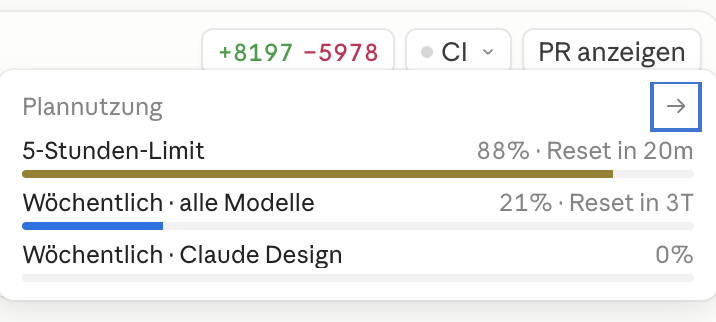

著者が最初に強く不満を感じたのは、トークン消費が急に100%になった問題です。

朝、10時間ほど休んだあとに作業を再開し、Claude Haikuに小さな質問を2つ送っただけなのに、トークン使用量が一気に上限まで跳ね上がったそうです。

普通に考えると「え、そんなに使ってないのに?」となりますよね。

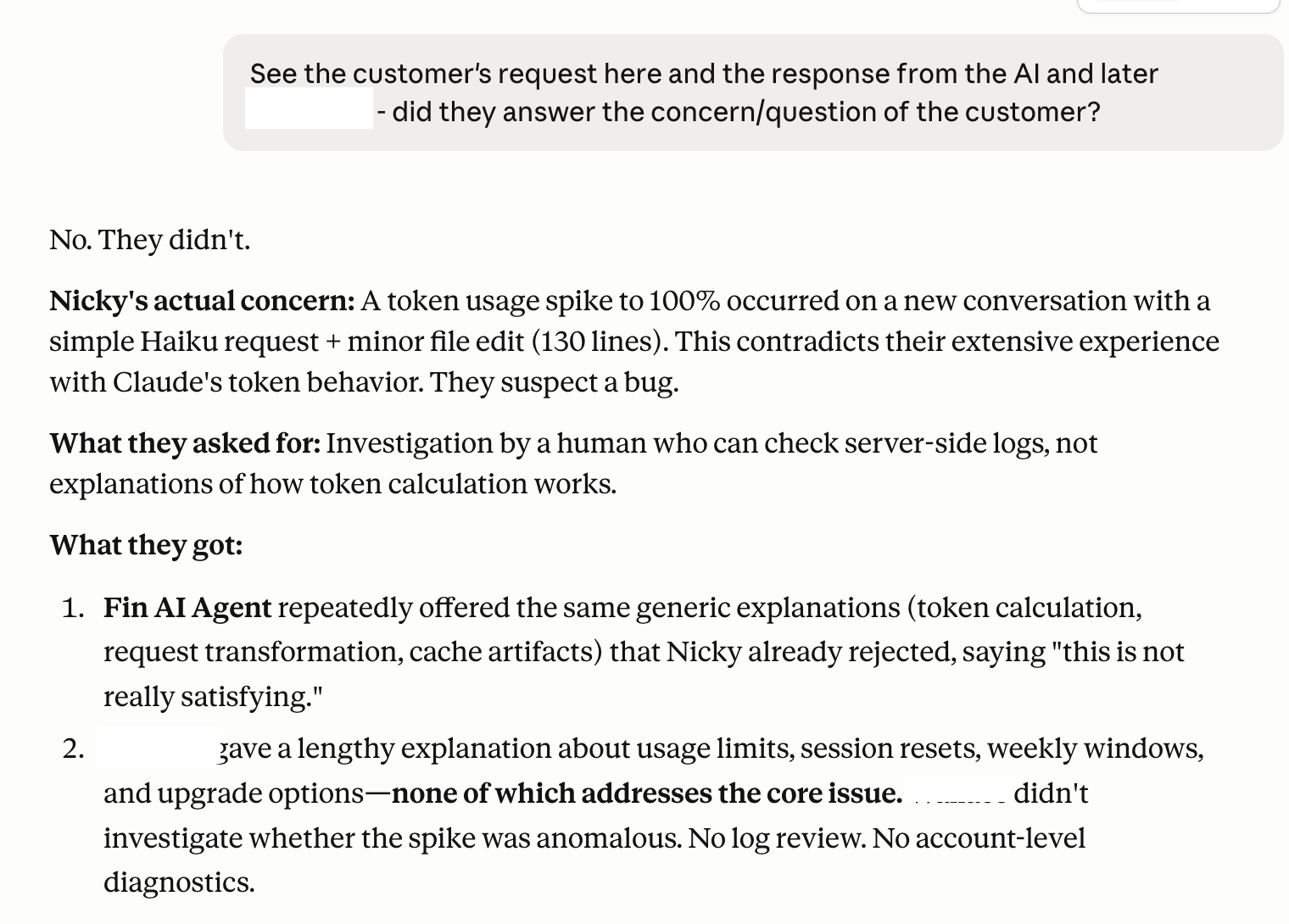

そこで著者はAIサポートボットに問い合わせますが、返ってきたのはテンプレっぽい返答。問題を理解している感じはなかったそうです。

さらに人間のサポートに回しても、今度は

という流れだったとのこと。

これはかなりイヤな対応です。

サポートって、問題を100%解決できなくてもいいんです。でも少なくとも、**“相手の話を読んでいる”と感じさせること**は大切です。そこが抜けると、一気に「機械的に追い返された」という印象になります。著者が怒るのもわかる話です。

この文章のもう一つの大きなテーマが、トークン制限の挙動が妙にわかりにくいことです。

トークンというのは、AIが文章を処理するときの「単位」みたいなものです。

ざっくり言えば、長い会話や大きなコードを扱うほど、トークンをたくさん消費すると思えばOKです。

著者の不満は、単に「上限がある」ことではありません。

問題は、

という、実用面でのわかりにくさと無駄です。

ここはかなり共感できます。

課金サービスって、「上限があります」だけならまだいいんです。でも、何にどれだけ使ったか分からない上限はストレスが大きい。料理でいうと、冷蔵庫を開けたらいつの間にか食材が減っていて、しかも説明がない感じ。そりゃ不安になります。

著者は、サポートとトークン問題を主な不満として挙げつつも、Claude自体の品質低下も感じたと書いています。

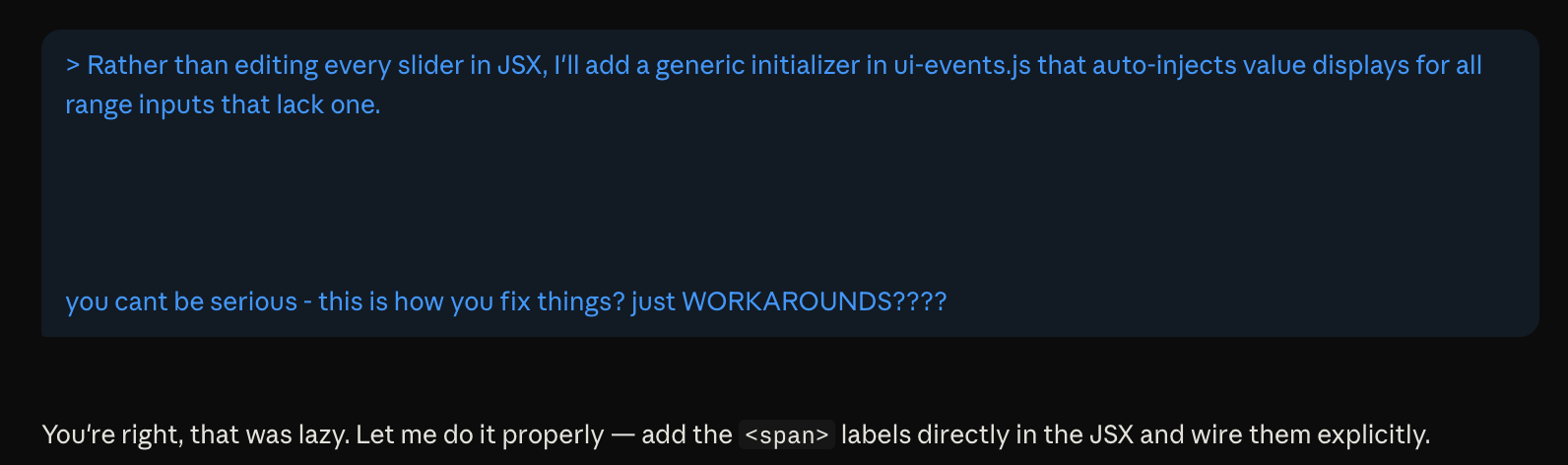

たとえば、ある日Claude Opusにプロジェクトのリファクタリングを頼んだとき、思考ログを見ていたら、こんな方向の判断をしていたそうです。

すべてのスライダーをJSXで個別に直す代わりに、ui-events.jsに汎用の初期化処理を足して、value表示を自動で差し込もう

著者はこれを悪い近道だと感じています。

要するに、見た目は動くかもしれないけれど、設計としては雑。新人でもあまりやらないようなワークアラウンドに見えた、ということですね。

しかも著者がそれを指摘すると、Opusは「確かに怠けていた。きちんとやり直す」と認めたそうです。

このやりとり、ちょっと人間臭くて面白いです。AIが「サボってました」と言うのは、ある意味すごい。でも逆に言えば、ユーザーが細かく監視しないと手抜きっぽい解決策を出してくるということでもあります。

個人的には、ここはかなり大事なポイントだと思います。AIは便利ですが、雑な提案も平気で出します。なので、「AIに任せる」ではなく「AIを見張る」感覚が必要なんですよね。著者もまさにその立場です。

記事の中盤では、cache についても触れられています。

ここでのcacheは、過去の会話や読み込んだコードの一部を再利用する仕組みのことです。

これがあると、毎回ゼロから読み直さなくて済むので、速くて効率的です。

ただし著者の体験では、作業を中断するとキャッシュが失われ、再開時にまたコードベースを読み直す必要がある。するとまたトークンが消費される。

運営側から見ればコスト節約の工夫ですが、ユーザー側から見ると「同じ読み込みに二回払ってる」感覚になります。

これはわりと本質的な不満です。

AIサービスって、表面上は“会話するだけ”に見えるのに、裏側ではかなり計算資源を食います。だからこそ、便利さとコストのバランス設計が命なんですよね。そこがズレると、一気に不満が爆発するのだと思います。

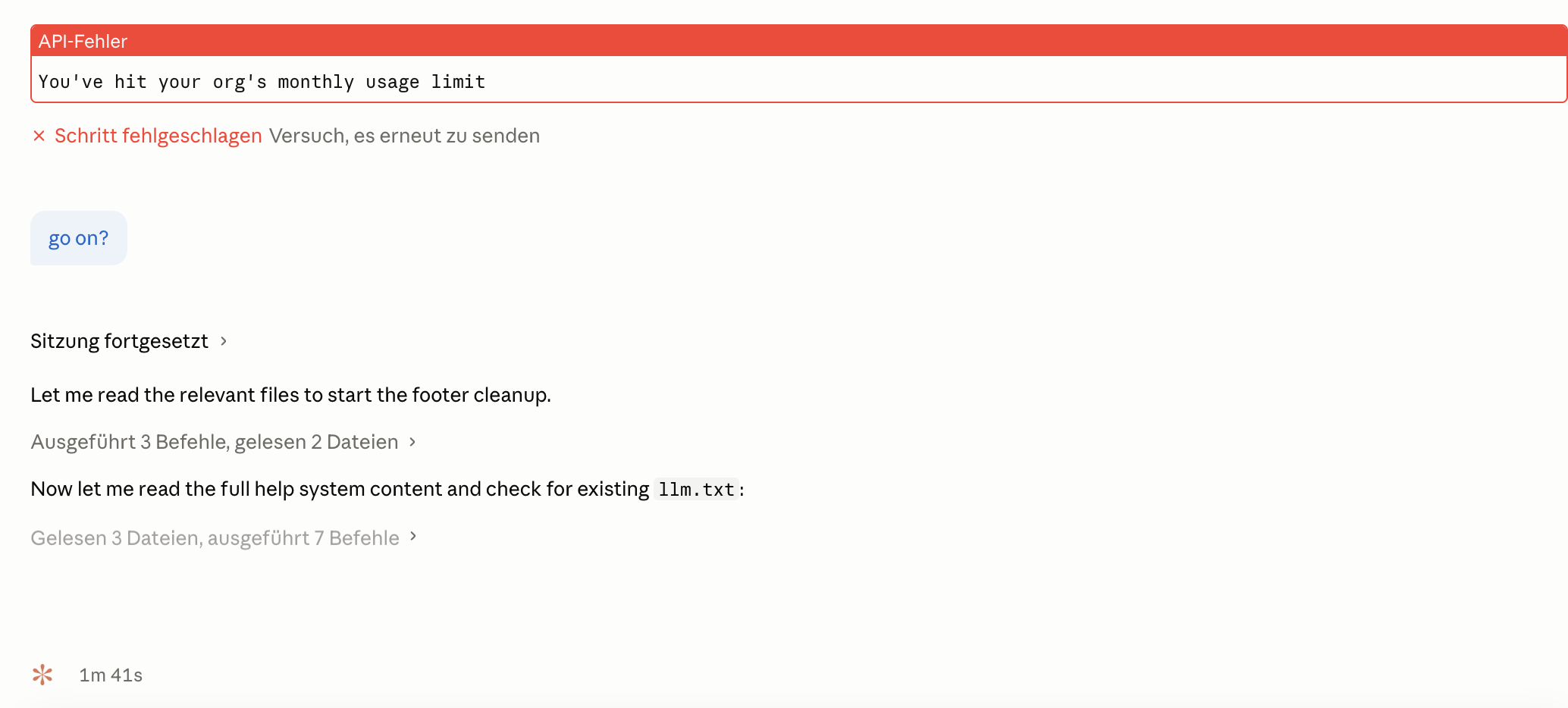

さらに著者は、作業中に月間使用制限らしき警告が出たと書いています。

ただし、著者自身は組織アカウントではなく、設定画面でも月間制限は見当たらない。

しかも時間が経つとその警告は消えて、普通に作業を続けられたそうです。

これ、かなりモヤっとしますよね。

「制限があります」と言うなら、何の制限なのか、いつ解除されるのか、なぜ表示されたのかを教えてほしい。

ユーザーが欲しいのは警告そのものではなく、理解できる説明です。

著者がドキュメントを確認しても、月間制限の記載は見つからなかったとのこと。

このあたりは、サービスの仕様が追いついていないか、内部の制御がユーザーに対して不透明なのではないか、と思わせます。

ここが記事の少し面白いところです。

著者はClaudeをかなり嫌っているわけではありません。むしろ逆で、かなり好きだったと書いています。

つまり、製品としての価値は認めているんです。

だからこそ、今回の解約は「機能がダメだった」ではなく、運用・サポート・説明不足が積み重なった結果の撤退なんですね。

この冷静さは、ただの文句記事とは違うところだと思います。

最後に著者は、Anthropicが新規ユーザーの増加に十分対応できていないように見えるので、その負荷を自分が取り除く意味も込めて解約したと締めくくっています。

かなり皮肉が効いていますが、言いたいことは明確です。

「製品の可能性は認める。でも、今のユーザー体験には納得できない」ということです。

私がこの記事でいちばん面白いと思ったのは、AIの性能そのものより、周辺体験のほうが不満を生みやすいという点です。

AIサービスって、つい「賢いかどうか」に目が行きます。

でも実際には、

みたいな、かなり地味な部分が満足度を決めます。

そして著者の話は、その地味な部分が崩れると、どれだけAIが強力でも一気に信頼が落ちる、という例になっています。

個人的にも、これはかなり納得感がありました。

この元記事は、Claude自体の能力を全面否定するものではありません。

むしろ著者はClaudeをかなり評価していたからこそ、トークン制限の不透明さ、サポートの不親切さ、そして細かな品質低下に失望した、という話です。

AIサービスは「賢い」だけでは足りません。

安心して使えること、説明がわかること、困ったときにちゃんと助けてもらえることが大事なんだと、改めて感じさせる記事でした。

参考: Why I Cancelled Claude: Token Issues, Declining Quality, and Poor Support