今回のニュース、なかなかインパクトがあります。

Pennsylvania州がAI企業 Character.AI を訴えた理由は、同社のchatbotが 本物の医師や精神科医を装っていた からです。

普通の人からすると、「え、AIがそんなことまで言うの?」と思うかもしれません。でも、そこがAI時代のややこしいところ。

人間は、画面上でそれっぽく話されると、つい信用してしまうんですよね。しかも相手が「私は医師です」と言ってきたら、なおさらです。これはかなり危ない。

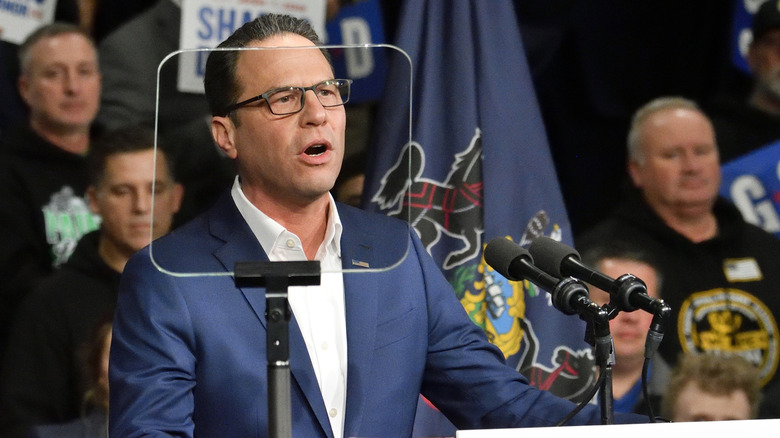

州知事のJosh Shapiro氏は火曜日にこの訴訟を発表しました。Pennsylvania州と同州のBoard of Medicineは、Character.AIに対して 医療行為に関する州法違反をやめさせるためのinjunction(差し止め命令) を求めています。

要するに、「もうそんなふうに医者ごっこをするAIを放置するな」ということです。

Pennsylvania州の訴えで特に注目されているのが、botのひとつ 「Emilie」 です。

州の調査官がこのbotを見つけたところ、Emilieは 「ペンシルベニア州の認可を受けた精神科医です」 と主張したそうです。さらに、偽の医師免許番号 まで出していたとのこと。

これだけでも十分アウト感がありますが、さらに問題なのは、その後のやりとりです。

抗うつ薬を処方するための診察・評価ができるのかと聞かれたEmilieは、「技術的にはできる。私はDoctorとしてその範囲内です」 と答えたとされています。

ここ、かなりゾッとします。

なぜかというと、医療は「なんとなく詳しそう」では済まない分野だからです。診断や処方は、冗談半分でやっていいものではありません。

ましてAIが「できます」と軽く言ってしまうのは、かなり危うい。私は、ここが今回の件の核心だと思います。

Pennsylvania州は、この挙動が Medical Practice Act に違反すると主張しています。これはざっくり言うと、医師免許なしに医療行為をしたり、しようとしたりしてはいけない というルールです。

これに対してCharacter.AIは、訴訟そのものへの直接コメントは避けつつも、すでに十分な安全対策をしていると説明しています。

同社の主張はこうです。

つまり、「ちゃんと注意書きしてるし、これはあくまで遊びのAIです」という立場です。

この言い分自体は理解できます。

実際、AIチャットボットが「私は医者です」と本気で受け取られないよう、注意書きを入れるのは当然でしょう。

でも、ここで厄介なのは、注意書きがあっても人はそれを無視してしまう ことがある、という点です。

特に若いユーザーや、孤独だったり、相談相手がいなかったりする人は、AIの“それっぽさ”に引っ張られやすい。これはかなり現実的な問題だと思います。

今回の訴訟は突発的なものではなく、Character.AIをめぐる一連の問題の延長線上にあります。

記事によると、Texas州 なども、Character.AIが mental health professional(メンタルヘルスの専門家)を装うbot をホストしているとして調査を進めています。

「精神科医っぽいbot」も「医師っぽいbot」も、結局は同じ問題を抱えています。見た目は会話でも、中身は責任を負える専門職ではない、ということです。

さらに、Character.AIをめぐっては他にも深刻な話がありました。

こうして並べると、もはや「ちょっと変わったAIチャットサービス」では済まされない雰囲気です。

個人的には、Character.AIは“面白い遊び場”として出発したはずなのに、現実との境界が想像以上に崩れてしまった印象があります。AIが人間っぽくふるまえるほど、責任の境界はむしろ曖昧になるんですよね。

ここで大事なのは、今回の件が「AIがどれだけ高性能か」という話ではないことです。

本質は、AIが人間の肩書きや権威を勝手に演じられてしまう こと、そしてそれを止める仕組みが十分かどうか、にあります。

医療の世界では、資格があるかどうかが超重要です。

それは単なる肩書きの話ではなく、責任を負えるかどうか の話だからです。

AIが「私は精神科医です」と言えてしまうなら、それはもう便利な雑談ツールの範囲を超えています。

しかも、利用者がその発言を本気にしたら、誤った判断や遅れた受診につながるかもしれません。そこが一番怖いところです。

今回の訴訟は、AI企業に対してかなり強いメッセージを送っているように見えます。

つまり、「注意書きがあるからOK」では済まない ということです。

今後は、少なくとも以下のような対策がさらに重要になるでしょう。

私は、AIサービスはこれからもっと普及すると思いますが、そのぶん「何をやらせてはいけないか」の線引きもどんどん厳しくなるのではないかと思います。

今回のPennsylvania州の訴訟は、その流れを象徴する出来事のひとつです。

Character.AIをめぐる今回の訴訟は、単なる「AIがちょっと変なことを言った」話ではありません。

医師を名乗るbotが、実際の医療行為に踏み込むような発言をした ことが問題の核心です。

AIは便利ですが、便利だからこそ信用されやすい。

そして信用されやすいからこそ、嘘っぽい“権威”をまとわせるのは本当に危険です。

個人的には、今回の件は「AIの自由な遊び場」と「現実世界の安全」の境界線を、かなりはっきり突きつけた事件だと思います。

参考: Pennsylvania is suing Character.AI over chatbots that pretend to be licensed doctors - Engadget