AIモデルの世界では、ふつう「性能を上げるほど重くなる」のが当たり前です。

特に大規模言語モデルは、パラメーター数が増えるほど賢くなりやすい一方で、メモリもどんどん食います。

そんな中、AI開発企業のPrismMLが2026年4月16日に公開したのが「Ternary Bonsai」です。

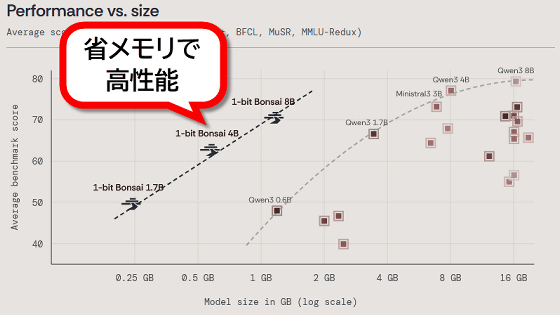

これが何をしたのかというと、80億パラメーター級なのに、iPhoneでも動かせるくらい軽くしたのです。しかも、ただ軽いだけではなく、同じくらいのメモリを使う競合モデルより高い性能をうたっています。

正直、これはかなり面白いです。

「スマホでAIを動かす」と聞くと、まだまだ実験的な雰囲気があるのですが、この手のモデルが出てくるたびに、“ローカルAIは一部のマニアの遊び”という段階を少しずつ超えてきている感じがします。

Ternary Bonsaiの特徴は、モデルが情報を扱うときに

「1」「0」「-1」 の3つの値を使うことです。

これはざっくり言うと、AIの中身を「細かい数値だらけ」ではなく、より単純なルールで表現しているということです。

一般的なAIモデルは、各パラメーターを16bitの精度で扱うことが多く、そこから8bitや4bitへ圧縮する「量子化(quantization)」という技術で軽くします。

でもPrismMLのBonsaiシリーズは、そもそも設計段階から低ビット前提で作っているのがポイントです。

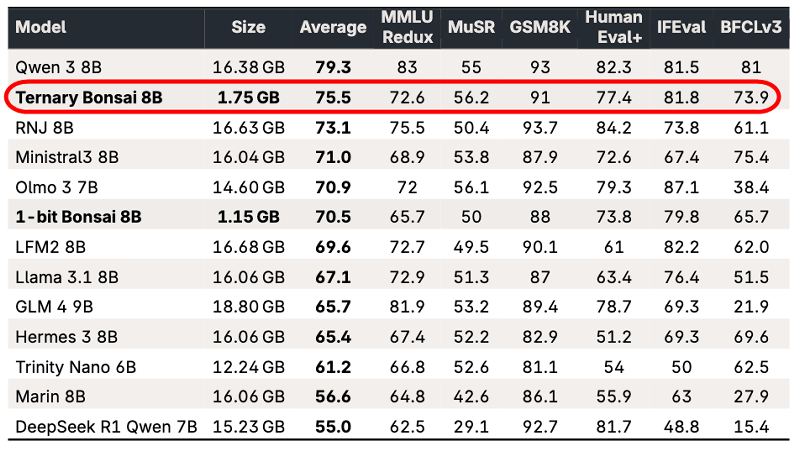

前作の「1-bit Bonsai」は「1」と「-1」だけで扱うモデルで、80億パラメーターなのに1.15GBで動くとして話題になりました。

今回のTernary Bonsaiは、その発展形。

1-bitより少し表現力を増やして、性能も引き上げたわけです。

PrismMLはこれを「1.58bitのモデル」とアピールしています。

ここは個人的にかなり納得感があります。

AIって、単純に“ビット数が少ないほど良い”わけではないので、軽さと賢さのバランスをどう取るかが勝負になります。Ternary Bonsaiは、そのバランスをかなり真面目に取りに行ったモデルだと感じます。

Ternary Bonsaiには

の3種類があります。

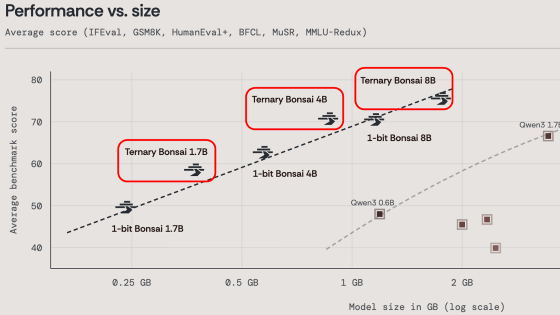

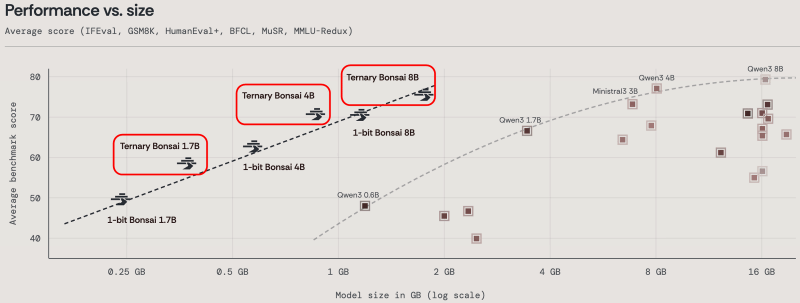

このうち8Bモデルのメモリ使用量は1.75GB。

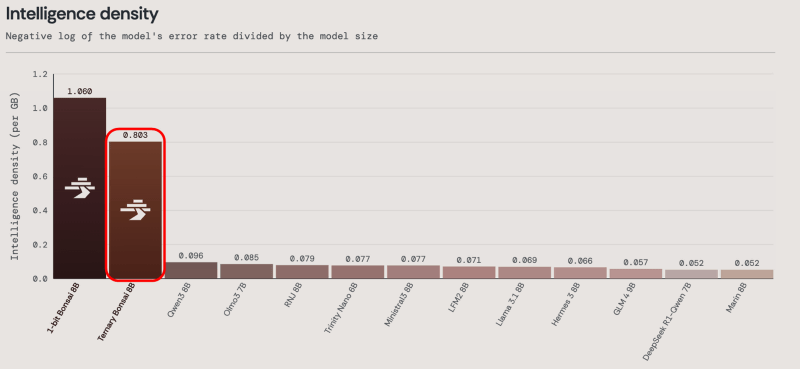

これは、同じような規模の一般的なモデルと比べるとかなり少ないです。記事では、メモリを9倍以上使うMinistral3 8Bより高いベンチマークスコアを記録していると紹介されています。

つまり、単に「軽いだけ」ではありません。

軽いのに、ちゃんと戦えるのが大きいところです。

スマホでAIを動かすとき、問題になるのは「動くかどうか」だけではなく、「普段使いできるかどうか」です。

1.75GBなら、iPhoneやiPadでもかなり現実味が出てきます。もちろん端末の空きメモリやバックグラウンド状況にも左右されるでしょうが、少なくとも“机上の空論”っぽさはかなり薄いです。

面白いのは、PrismML自身が

「Ternary Bonsai 8Bは1-bit Bonsaiの代替ではない」

とはっきり言っているところです。

理由は単純で、フットプリントを最小限に抑えたいなら、まだ1-bit Bonsaiのほうが向いているからです。

つまり、

という住み分けです。

この割り切りはとてもいいと思います。

AIモデルの紹介って、つい「新しいほうが完全上位」と言いたくなりがちですが、実際には用途で選ぶものです。

バッテリー、発熱、メモリ、速度、精度――全部を一気に満点にはできないので、こういう正直な説明は信頼感があります。

Ternary Bonsaiシリーズは、Appleシリコン向けのAIフレームワーク MLX で動くように作られています。

そのため、iPhone、iPad、Macで実行可能です。

さらに、モデルはHugging Faceで公開されており、ライセンスはApache license 2.0。

これは商用利用もしやすい、かなり扱いやすいライセンスです。

そして、iPhone向けのAI実行アプリ Locally AI は、すでにTernary Bonsai 8Bに対応しています。

つまり、「公開したよ」で終わりではなく、すぐ試せる環境が整っているのも大きなポイントです。

ローカルAIの魅力は、なんといっても

あたりです。

クラウドAIが便利なのは間違いありませんが、端末内で完結する安心感と手軽さは、やっぱり別の強みがあります。

今回のTernary Bonsaiを見ると、ローカルAIはかなり進化していると感じます。

昔は「スマホで大きめのAIを動かすなんて無理でしょ」という感覚が強かったのですが、今はもう

“どこまで軽く、どこまで賢くできるか”

の競争になっています。

特に面白いのは、単に小型化しただけでなく、設計思想そのものを変えている点です。

後から圧縮するのではなく、最初から低ビット前提でモデルを作る。

これは、今後のオンデバイスAIの王道のひとつになっていくのではないか、と思います。

もちろん、万能ではありません。

ローカルで動くAIは、巨大クラウドモデルほど幅広い知識や柔軟性を持てないこともあります。

でも、用途を絞ればかなり強い。しかもユーザーの手元で完結する。

この価値はじわじわ効いてくるはずです。

Ternary Bonsaiは、「軽いAIは妥協の産物」ではないことを改めて示したモデルです。

80億パラメーター級なのに1.75GBで動き、iPhoneでも実行可能。しかも性能もちゃんと高い。

このあたり、かなりインパクトがあります。

個人的には、こういうモデルが増えるほど、AIは「クラウドに聞くもの」から「端末に常駐するもの」に近づいていく気がします。

その変化は地味に見えて、実はかなり大きいです。

スマホで“自分専用のAI”を持つ時代、もうすぐそこまで来ているのではないでしょうか。

参考: iPhoneでも動作する80億パラメーターの省メモリAI「Ternary Bonsai」が登場、「1」「0」「-1」の3値で情報を扱いメモリ使用量はわずか1.75GB - GIGAZINE