Razerがちょっと面白い実験をやりました。

April Fools' Day 2026のキャンペーン「AVA Mini」で、ユーザーにペットの写真をアップロードしてもらい、それをもとに3D風のAIコンパニオンキャラクターを生成するという企画です。いわゆる「遊び心のあるAIプロモーション」なのですが、驚くべきはその裏側でした。

このキャンペーンで生成された画像は、3月31日から4月4日までの間に1万1000枚以上。しかも、これを動かしたのはAWSやGoogle Cloudのような巨大なクラウドサービスではなく、Akash Network という分散型の計算資源マーケットプレイスでした。

ざっくり言うと、世界中に散らばっているGPUの持ち主が「うちの計算力を貸します」と出品し、それを必要な人が借りる仕組みです。

GPUはAI画像生成や動画生成でよく使われる、AI向けの“高性能な頭脳”みたいなもの。普通は大手クラウドからまとめて借りることが多いのですが、Akashのような仕組みでは、個人や小規模事業者のGPUを市場から集めるイメージです。

Razerはここに目をつけて、AkashML を通じて計算資源を調達しました。

記事によると、使われたのは RTX 4090 や RTX 5090 を載せた個々の提供者のマシン。つまり、巨大データセンターの一角ではなく、世界中の“散らばったGPU”がキャンペーンの裏で働いていたわけです。こういう構図、かなり今っぽいです。私は正直、ちょっとワクワクします。

理由はシンプルで、安くて、必要なときに勝手に増やせるからです。

記事では、一般的な inference API(AIに画像を作らせるAPI、つまり“AIに仕事をさせる窓口”)だと、同等のFlux系モデルの画像生成は1枚あたり$0.03〜$0.15くらいかかることがあるとしています。

これがもし無料の一般向けキャンペーンなら、枚数が増えるほどかなり苦しい。下手をすると、楽しい販促がそのままコスト地獄になります。

そこでAkashMLを使ったところ、1枚あたり$0.01 まで下がった。

この差は小さく見えて、キャンペーン規模だとかなり効きます。1万枚単位になると、数千ドル単位の差になる可能性があるからです。こういうの、表向きは“面白い企画”でも、裏ではしっかり経営の話なんですよね。

今回の仕組みは、単に安いだけではありません。

RazerのAIKitコンテナが複数のマシンで動き、AkashMLがそれをまとめて管理しました。さらに、

といった運用ができたそうです。

要するに、ユーザーが増えても裏側で自動的に台数を増やして耐えた、ということです。

クラウドでやるなら珍しくない話ですが、これを分散型の市場でやっているのが面白い。従来の「大手クラウドが全部持つ」発想から、少し違う未来を感じます。

数字もなかなか立派です。

ここは重要です。

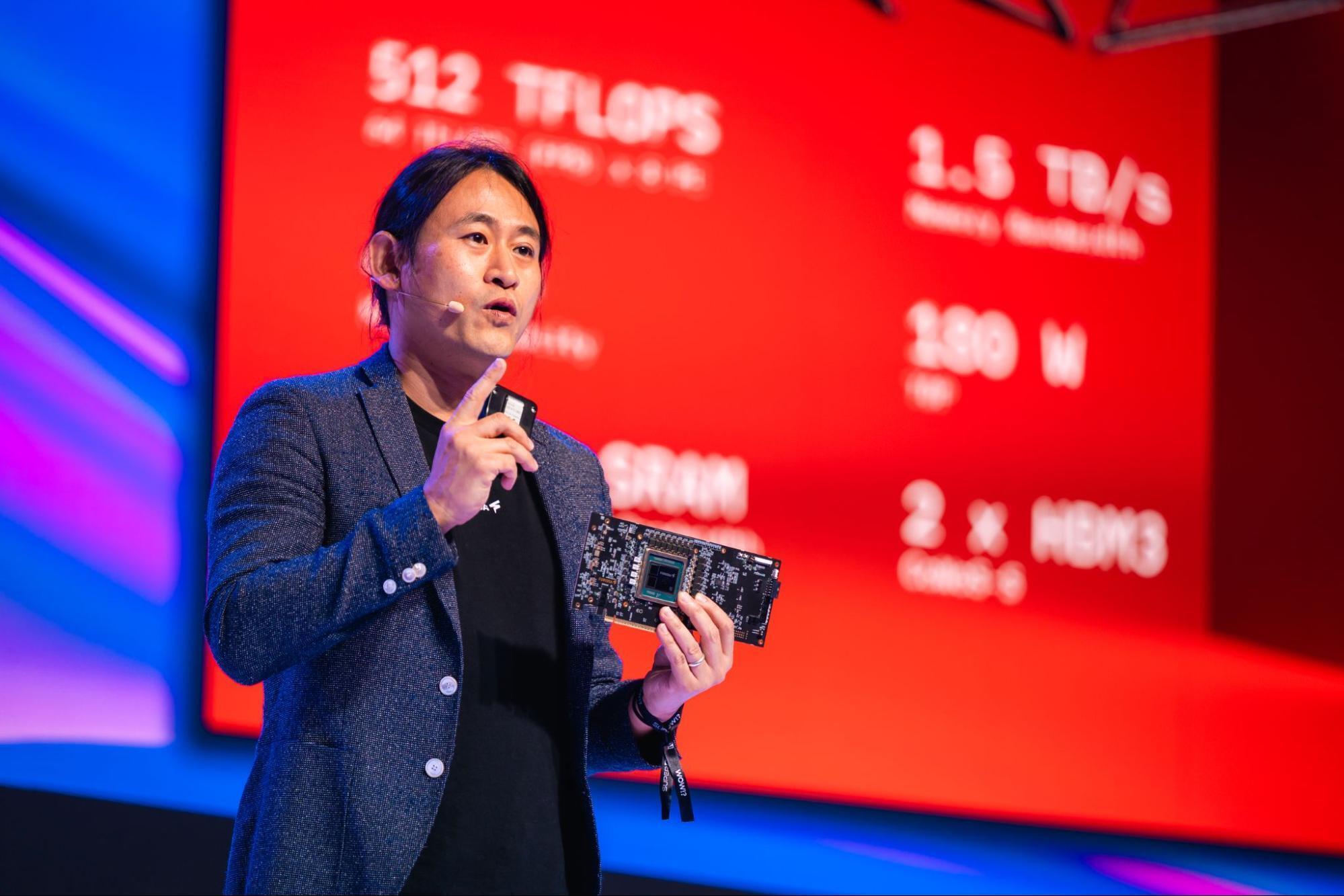

安いだけなら“実験”で終わりますが、実運用でちゃんと回ったのがポイント。しかも、画像生成に使ったBlack Forest Labsの4-billion-parameter Fluxモデルは、単一のコンシューマーGPUのメモリ内に収まったとされています。

専門用語をかみ砕くと、これは「高価な業務用マシンじゃなくても、一般的な高性能ゲーミングGPU級で十分動いた」という意味に近いです。

AIがどんどん“超巨大設備専用”から“手の届く機材でも扱えるもの”に下りてきている感じがします。

個人的に一番面白いのは、AIのコスト構造が変わり始めていることです。

これまでAIといえば、どうしても「クラウド大手に高い料金を払うもの」という印象が強かった。でも今回みたいに、世界中に眠っているGPUを市場として束ねれば、用途によってはかなり安く回せる。

もちろん、すべての本番AIシステムがこの方式に向くわけではありません。高い信頼性や厳密な運用が必要な場面では、まだ大手クラウドのほうが安心だと思います。記事の中でも、高い同時接続が続く本番環境では、典型的なlocal-firstツールチェーン以上のエンジニアリング調整が必要だと触れています。

ただ、それでも「キャンペーンや一時的な需要」に対しては、かなり有力な選択肢ではないかと思います。

特に、今回のような“アクセスが一気に跳ねるけど、ずっと使い続けるわけではない”用途には相性がいい。これは広告・販促・イベント系のAI活用にとって、かなり大きいはずです。

Akash Networkの創業者Greg Osuri氏も、RazerのAIKitを分散コンピュートネットワーク上で動かせたことに前向きなコメントをしています。さらに、Akash HomenodeやRazer製品への展開も視野に入れているようです。

ここから見えてくるのは、AIインフラが「データセンターの中だけの話」ではなくなってきていること。

家の中のPC、世界中に散らばった消費者向けGPU、そしてアプリ側の工夫。こうしたものを組み合わせて、必要な分だけ計算力を集める時代に入りつつあるのかもしれません。

もちろん、分散型だからこその難しさもあります。

たとえば、性能のばらつき、通信の遅延、セキュリティ、データの扱いなど、考えることは山ほどあります。なので「クラウドの完全な置き換え」とまではまだ言えないでしょう。

でも、**“安くて速くて、ピークに強い”キャンペーン用途**で成功例が出たのはかなり意味がある。私は、こういう実例が増えるほど、AIインフラの常識は静かに書き換わっていくのではないかと思います。

参考: Razer taps decentralized compute marketplace to run massive AI campaign