Google DeepMindが発表した Gemma 4 は、ひと言でいえば「オープンモデルの性能を、かなり本気で押し上げてきた新世代モデル」です。

しかもただ大きいだけではなく、少ない計算資源でも強い、いわば“コスパのいい賢さ”を前面に出してきたのが面白いところだと思います。

AIモデルの世界では、巨大モデルが強いのは当たり前。でも実際に使う側からすると、重すぎるモデルは扱いにくい。そこに対してGemma 4は、advanced reasoning(高度な推論) や agentic workflows(AIが自律的にタスクを進めるワークフロー) に向けて設計された、かなり実戦向けのオープンモデルとして登場しました。

Googleの発表では、Gemma 4は 「これまでで最も知的なオープンモデル」 とされています。

ここで大事なのは、単にパラメータ数を増やした、という話ではないことです。

AIモデルは、ざっくり言うと「脳の大きさ」と「賢さ」のバランス勝負です。

脳が大きければ強くなりやすいのですが、当然コストも上がる。GPUも電力も必要になる。なので本当に嬉しいのは、小さめでもちゃんと賢いモデルです。

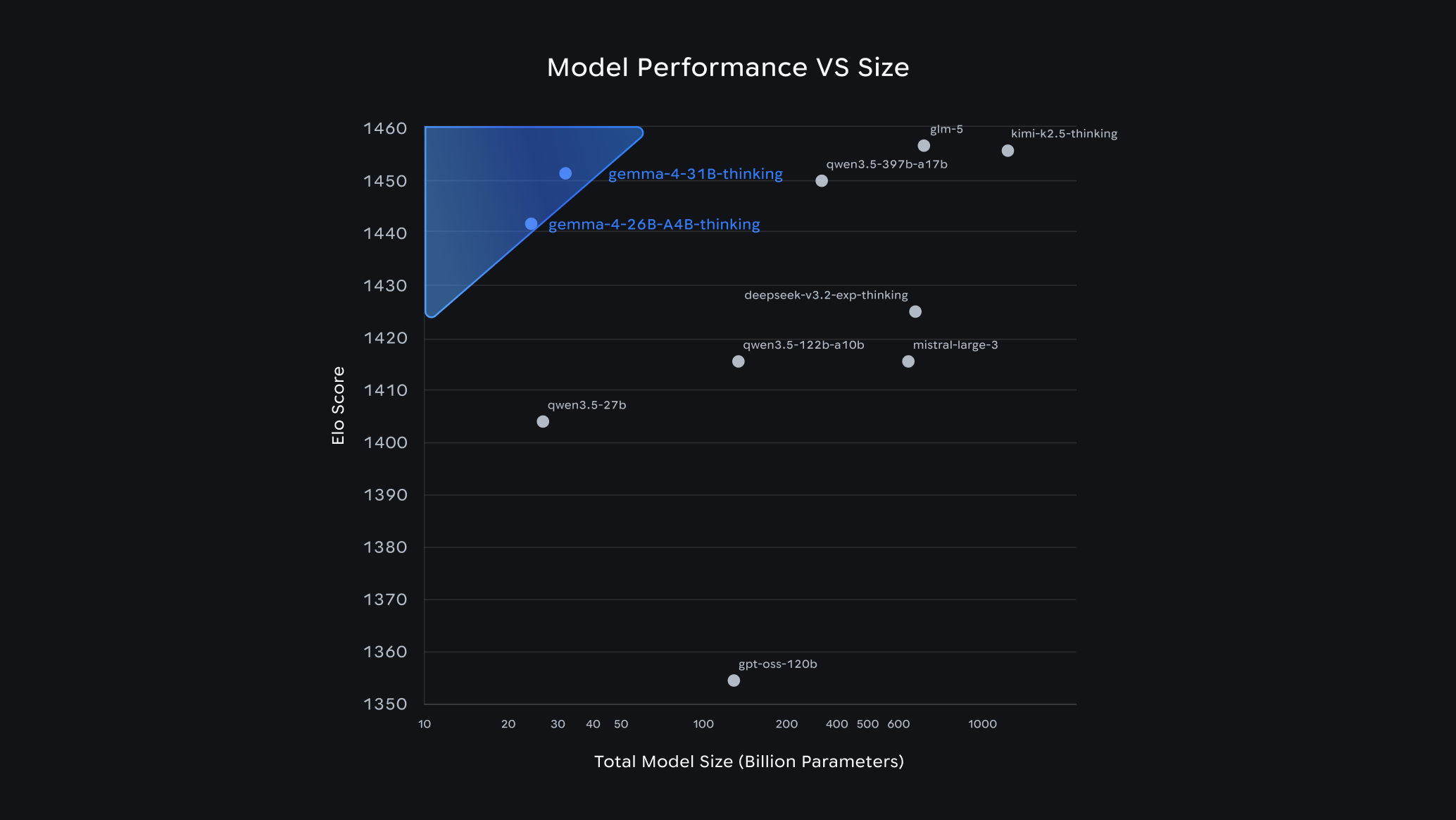

Gemma 4はまさにそこを狙っていて、Googleはこれを “byte for byte”、つまり「サイズあたりの性能が強い」と強調しています。

この言い方はちょっと攻めていますが、言いたいことははっきりしていて、**“大きさで殴るAI”ではなく、“効率で勝つAI”** を目指しているわけです。これはかなり好感が持てます。

Gemma 4は、次の4サイズで提供されます。

ここで少し用語の補足をすると、

このラインナップを見ると、Googleはかなり明確に使い分けを意識しています。

小型モデルは端末側や軽量用途、中大型モデルは高度な推論や開発用途。

この割り切りはかなり現実的で、個人的には好きです。AIは「何でも最大サイズで」より、「用途に応じてちゃんと選べる」ほうが絶対に使いやすいからです。

今回のGemma 4は、単なる会話AIではなく、複雑なロジックやagentic workflowsを扱えるように作られています。

agentic workflows というのは少し難しく聞こえますが、簡単に言えば、

といった流れを、AIがある程度自分で回していく使い方です。

つまり、昔の「質問したら答えるだけのAI」より一歩進んで、

“仕事を手伝うAI” に近づいているわけです。

この方向性は今のAI開発の本流そのもので、Gemma 4がここを真正面から狙っているのはかなり重要だと思います。

Gemma 4は Apache 2.0 license で公開されています。

これは開発者にとってかなり扱いやすいライセンスです。細かい法的な話を全部ここでやる必要はありませんが、要するに「比較的自由に使いやすい」ということです。

GoogleはGemma 4を、Geminiモデルと対になる存在として位置づけています。

Geminiが“Googleの本命プロダクト側”だとすれば、Gemmaは“外に開いて広く使ってもらう側”。

この二本立てはかなり強い戦略だと思います。

なぜなら、最先端モデルはクローズドな環境だけで育つものではなく、研究者や開発者に触られ、改造され、派生モデルが生まれて初めて本当に伸びるからです。

Googleが言う Gemmaverse という表現も、そうしたコミュニティの広がりをかなり意識しているのだろうと感じます。

Googleによると、Gemmaの初代登場以来、ダウンロード数は4億回超、さらに 10万を超える派生モデル が生まれているとのことです。

この数字は、単なる宣伝文句として片づけるには大きいです。

オープンモデルは「出したら終わり」ではなく、コミュニティに採用されて初めて存在感が出ます。

その意味でGemmaシリーズは、すでにかなり強い土壌を持っていると言えます。

そして今回のGemma 4は、その流れをさらに押し進める発表です。

“使ってもらえるモデル”から、“本気で選ばれるモデル”へ と進化したい、というGoogleの意志が見えます。

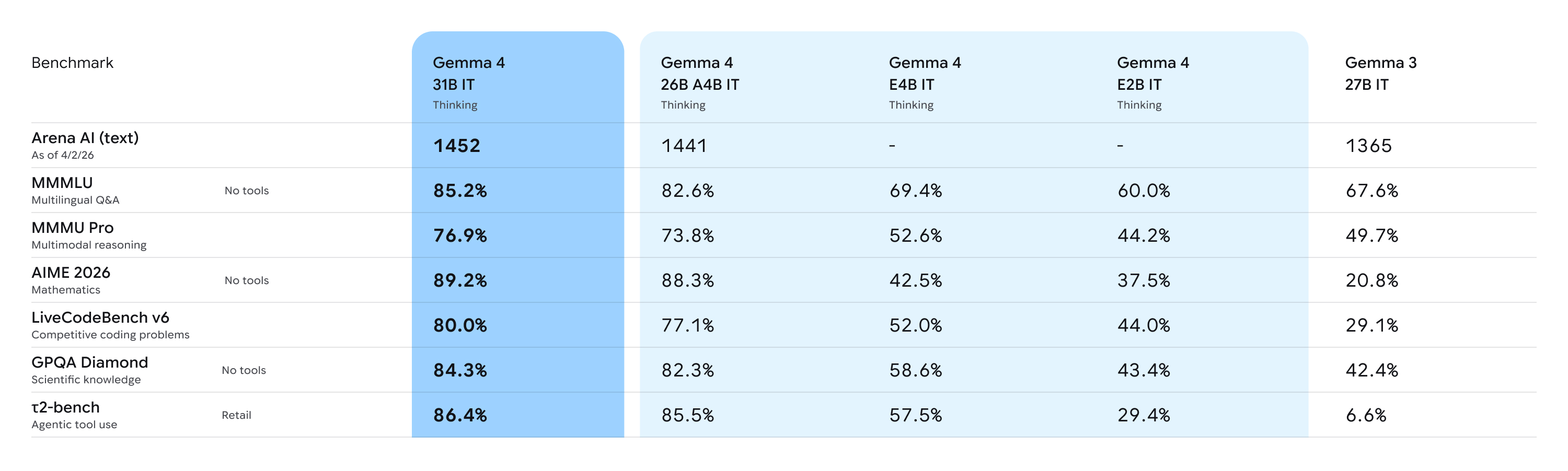

Googleは、Gemma 4の上位モデルについて、かなり強い性能をアピールしています。

しかも、サイズが20倍も大きいモデルを上回る としています。

これはかなりインパクトがあります。

ただし、こういうランキングは評価方法や時期で順位が変わることもあります。なので、絶対的な真理として受け取るより、**“少なくとも今かなり強い位置にいる”** と見るのが冷静だと思います。

それでも、オープンモデルでここまで上位に食い込むのは十分にすごいです。正直、オープンモデル界隈の競争はかなり熾烈なので、この位置は相当目立ちます。

E2BとE4Bについては、Googleは mobile-first AI を強く意識しているようです。

つまり、スマホや端末の中で動かすことを見据えた設計です。

ここで重要なのは、単に軽いだけではないこと。

Googleはこの小型モデルで、

を重視しているとしています。

個人的には、ここがかなり実用的で面白いポイントです。

AIはクラウドで動かせば強いのは当たり前。でも、ネット接続やコスト、プライバシーを考えると、端末内でそれなりに賢く動く ことの価値はどんどん上がっています。

Gemma 4の小型モデルは、その流れに乗ったかなり重要な一手ではないでしょうか。

Gemma 4の印象を一言でまとめるなら、

「大きさ自慢ではなく、使える強さを突き詰めたモデル」 です。

もちろん、AIの性能は今後も競争が激しくなりますし、実際の使い勝手はベンチマークだけでは決まりません。

でも、Googleが今回打ち出した方向性はかなり筋がいいと思います。

この4つを同時に狙っているのが、Gemma 4の面白さです。

AIは結局、「大きいモデルがすごい」で終わる時代から、「どのサイズでもちゃんと使える」時代に移りつつあるのだと思います。Gemma 4は、その流れをかなりうまく体現した発表ではないでしょうか。