Tetherといえば、普通はUSDTの発行元として知られる会社です。

そのTetherが今度は、医療AIでかなり攻めた発表をしてきました。

公開されたのは QVAC MedPsy。

これは、病院の現場やスマホ、ウェアラブル端末、いわゆるエッジデバイス(クラウドではなく端末側で動く機器)で使えるように作られた医療向け言語モデルです。

ここで面白いのは、「大きいAIほど強い」という常識に真っ向から挑んでいることです。

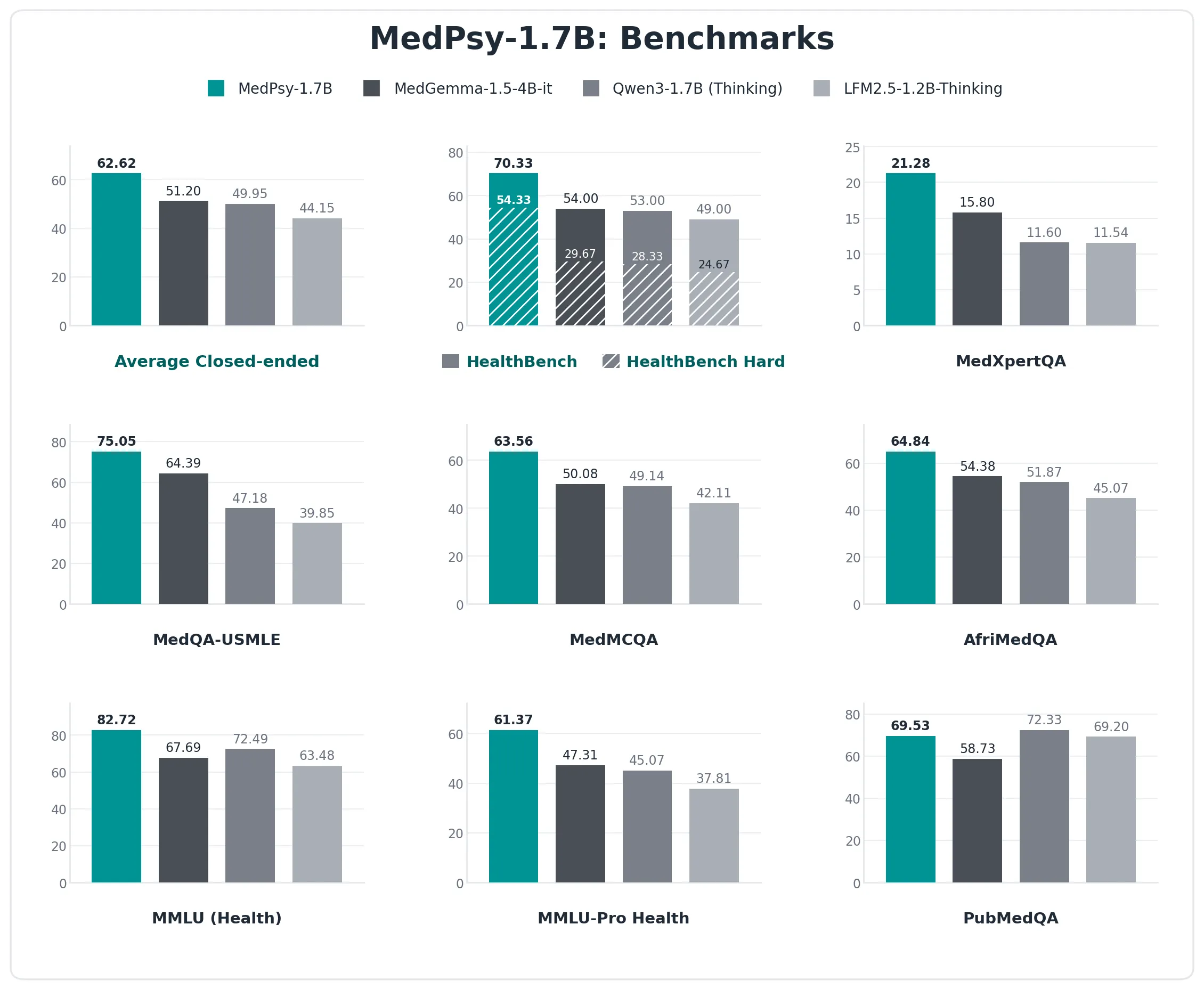

元記事によると、Tetherは 1.7 billion parameters(17億パラメータ)のモデルが、Googleの MedGemma-4B を上回り、さらに MedGemma-27B に対しても勝ったとしています。

しかも27Bは、サイズで見ると約16倍。かなりインパクトがあります。

もちろん、AIの世界では「大きい=強い」と単純には言えません。

学習の質、データの選び方、推論の効率化など、勝負どころはいろいろあります。

それでも、スマホで動く規模なのに、桁違いに大きいモデルより良い結果を出したという話は、かなり刺激的だと思います。

記事のポイントは、単に「小さいのに高性能」という話だけではありません。

むしろ本質は、医療AIを“現場の中”で動かせるようにしたことにあります。

Tetherによると、QVAC MedPsyは HealthBench Hard というベンチマークで高いスコアを記録しました。

これは、OpenAIが公開している評価基準で、実際の臨床現場に近い多段階の会話をAIにさせ、それを医師262人が評価するものです。

さらに、評価対象には以下のようなテストも含まれています。

このへんは地味に重要です。

ただ医学知識を暗記しているだけではなく、現実の会話や多様な地域の医療事情をどれだけ扱えるかを見ているからです。

AIのベンチマークは数字だけ見ると派手ですが、こういう“実務寄り”の評価を持ち出しているのは、かなり筋がいいと感じます。

Tether CEOの Paolo Ardoino は、今回の成果は「大きくすること」ではなく、効率を上げることに集中した結果だと述べています。

特に目を引くのが、トークン数の削減です。

トークンとは、AIが文章を処理・生成するときの“文字のかたまり”みたいなものです。

少なければ少ないほど、計算コストが下がり、応答も速くなりやすいです。

記事によると、4Bモデルは似た系統のシステムと比べて、1応答あたり約909 tokensで済むのに対し、比較対象は約2,953 tokens。

つまり、約3.2倍の削減です。

これはかなり実務向きです。

病院で使うなら、レスポンスが遅いのは困るし、クラウドに毎回投げるとコストもかかる。

何より、患者情報を外部サーバーに送ることへの心理的・法的ハードルが高い。

その点、端末内で完結するAIは、かなり相性がいいわけです。

個人的には、ここがこの話のいちばん面白いところです。

AIの性能競争ってつい「何Bモデルか」に目が行きがちですが、医療の現場では速い・安い・外に出さないが強い。

“賢さ”だけではなく、“扱いやすさ”が勝負になるんですよね。

Tetherは、MedPsyをGGUF形式で配布しています。

これは、モデルを軽量化して扱いやすくしたファイル形式で、記事では1.7Bモデルが1.2GB、4Bモデルが2.6GBとされています。

圧縮されているから、標準的なコンシューマー向けハードウェアでも動かせる、というわけです。

ここが重要なのは、クラウドを使わずに済むことです。

病院や診療所でAIを使うとき、患者データを外に出さずに済むのはかなり大きい。

記事でも、これはHIPAA exposure、つまり米国の医療情報保護ルールに関わるリスクを減らせる点として紹介されています。

要するに、

というメリットがあります。

特に、地方の診療所や病院内の限定環境では、この価値はかなり高いはずです。

AIが「すごい」だけでなく、「現場に置ける」ことが大切なんですよね。

ここはかなり強調しておきたいところです。

記事もちゃんと触れていますが、医療AIはまだ危ういです。

オックスフォード大学の研究では、LLMは危険な医療助言を返すことがあるとされました。

誤答や、症状のニュアンスを取り違える問題もあります。

研究者たちはAIを完全否定したわけではないものの、AIは**“physician(医師)”ではなく、“secretary(秘書)”として使うべき**だと述べています。

この表現はかなり本質を突いていると思います。

つまりAIは、

こういう役目には向いている。

でも、最終判断をAIに丸投げするのは危険、ということです。

医療は、ただ正解を当てればいい世界ではありません。

患者の背景、既往歴、症状の出方、緊急度、地域の医療体制まで絡みます。

だからこそ、今回のTetherのモデルがどれだけ優秀でも、「医師の代わり」ではなく「補助役」として見るのが現実的だと思います。

今回のMedPsyは、Tetherの最近の動きともつながっています。

記事によると、Tetherは先月 QVAC SDK を公開しました。

これは、iOS、Android、Windows、Linux でオフラインAIアプリを作るためのオープンソースツールキットです。

さらにその前には、QVAC Health というウェルネスアプリも出しています。

こちらは、バイオメトリックデータを端末内に保持する設計でした。

つまりTetherは、

「クラウドに依存しないAI」

をかなり一貫して押し出しているわけです。

個人的には、これは単なる技術トレンドというより、AIの使われ方を変えにいく戦略に見えます。

クラウド前提の巨大AIが主流のなかで、あえてローカル実行に寄せる。

これは地味だけど、医療や個人データの領域ではかなり強い発想です。

このニュースの本質は、たぶん「Tetherが医療AIを出した」こと以上に、

“医療AIは巨大モデルでなくても戦える”ことを示した点にあります。

もちろん、ベンチマーク結果はあくまでベンチマークです。

実際の診療現場では、法規制、UI、監査、責任分界、医師のワークフロー適合など、超えるべき壁が山ほどあります。

なので、これを見て「もうスマホAIで診断は完璧だ!」と受け取るのは危険です。

でも、方向性としてはかなり面白い。

小さい、速い、安い、外に出さない。

この4つを同時に満たせるなら、医療AIの使い道は一気に広がるはずです。

そして何より、

「AIは大きければ勝つ」という単純な物語を、またひとつ壊しにきた。

そこが今回のニュースのいちばん痛快なところだと私は思います。

QVAC MedPsyは、Tetherが打ち出したローカル実行型の医療AIです。

スマホや院内端末で動かせるのに、Tetherの主張では、Googleのより大きな医療モデルをベンチマークで上回ったとのこと。

もしこの結果が実運用でもある程度通用するなら、医療AIはクラウド依存からかなり自由になれるかもしれません。

ただし、医療AIはまだ“医者の代わり”にはなれません。

賢い補助ツールとして使うのが現実的で、その意味でも今回の発表は「夢があるけど、慎重さも必要」という、なかなかいい塩梅のニュースでした。

参考: Tether's Medical AI Runs on Your Phone and Outperforms Models 16x Its Size - Decrypt