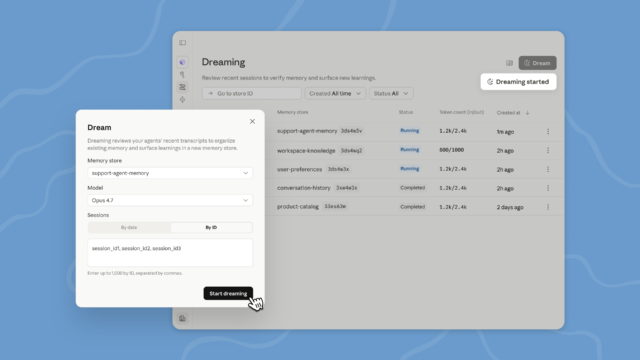

outcomes と multi-agent orchestration も、より広く使えるようになったAnthropicが開催した開発者向けイベント「Code with Claude」で、ちょっと目を引く機能が発表されました。名前は “dreaming”。直訳すると「夢を見る」ですが、もちろんClaudeが寝るわけではありません。

実態はかなり実務的で、最近の出来事を振り返って、あとで役立ちそうな情報を“記憶”として残す仕組みです。

要するに、AIが長い仕事の途中で「これはあとで必要そうだな」「この作業ではこういうミスが繰り返されているな」と見つけて、覚えておくわけです。

こう聞くと、かなり人間っぽいですね。まあ、夢というより「夜間のログ整理」と言ったほうが近い気もしますが、ネーミングとしては印象に残ります。こういう少しSFっぽい名前を付けるの、Anthropicは上手いと思います。

この記事の中心は Claude Managed Agents です。

これは、Anthropicが提供するClaude Platform上の、より高レベルなエージェント構築の仕組みです。

ざっくり言うと、

そんな用途向けの土台です。

Anthropicはこれを、Messages API から直接組むよりも上位の、「pre-built, configurable agent harness」 と説明しています。

難しい言い方ですが、要は 「エージェントを作るための、あらかじめ用意された管理付きの土台」 です。

一般向けには少し遠い話に見えますが、ソフトウェア開発や業務自動化の世界ではかなり重要です。AIを“1回会話して終わり”ではなく、仕事仲間みたいに長く動かす には、こういう仕組みが必要になります。

LLM(大規模言語モデル)は、会話や作業の内容をそのまま無限に覚えていられるわけではありません。

そこで出てくるのが context window です。

これは簡単に言うと、AIが一度に見て考えられる情報量の上限 のこと。

長い作業を続けていると、この枠から古い情報が押し出されてしまい、重要な前提まで忘れることがあります。

そこで多くのモデルは compaction という処理を使います。

これは、長いやりとりを定期的に見直して、どうでもいい部分は削り、重要な部分だけを残す 仕組みです。

ただし、Anthropicが今回言う “dreaming” は、単一の会話に対してだけ行うものではありません。

複数のエージェントや複数セッションをまたいで、過去の記憶を横断的に見直す のがポイントです。

ここ、地味ですがかなり大事です。

単発のチャット整理ではなく、チームで長期運用するAIの記憶管理 に近づいているからです。人間の仕事でも、会議が増えるほど「誰が何を決めたんだっけ」が問題になりますよね。AIでも同じことが起きるわけです。

Anthropicによると、dreamingは scheduled process、つまり決まったタイミングで動く処理です。

そこで

を見直し、必要なものだけを整理して保存します。

Anthropicは、dreamingが見つけられるものとして次のような点を挙げています。

つまり、個々の会話では見えない“パターン”を発見する のが売りです。

これはかなり面白いです。AIが単に答えるだけでなく、「仕事のやり方そのもの」を学習していく感じがあるからです。

個人的には、ここがこの機能の本丸だと思います。

AIの便利さは「知識があること」よりも、「使うたびに仕事の文脈に馴染んでいくこと」にあるので、記憶の整理はかなり価値が高いはずです。

この機能では、ユーザーは

のどちらかを選べます。

これは地味に良い設計です。

AIが勝手に何でも覚えてしまうと、便利な反面、「それは覚えなくていいのに」となりがちです。特に業務用途では、記憶の中身を人間が確認できるほうが安心です。

AIに“記憶力”を持たせるとき、問題になるのは性能よりも 何を覚え、何を忘れるか なんですよね。

ここをユーザーがコントロールできるのは、かなり現実的な判断だと思います。

ただし、この dreaming は research preview です。

つまり、正式版というよりは研究・試験的な段階で、すべての開発者が使えるわけではありません。アクセスは申請制です。

加えて、Anthropicは以前から公開していた研究プレビュー機能である

outcomesmulti-agent orchestrationも、より広く利用できるようにしたと発表しています。

multi-agent orchestration は、複数のAIエージェントをうまく連携させる仕組みです。

outcomes は文脈から見ると、作業の結果や進捗を扱う関連機能だと考えられますが、今回の本文だけでは詳細までは語られていません。

いずれにせよ、Anthropicは「AIを単体で使う」から「チームとして運用する」方向へ、着実に進めているように見えます。

この記事ではもう1つ、ユーザーにとってかなり直接的な話題もありました。

Claude Codeの Pro / Max ユーザー向けに、5時間の利用制限が倍になる とのことです。

これはかなり歓迎される変更だと思います。

理由はシンプルで、最近のAIサービスは便利な反面、「使いたいときに上限で止まる」問題 が本当にストレスだからです。

Anthropicは、需要に対して計算資源(compute infrastructure)が追いつかず、ユーザーの不満がたまっていたことに対応したと説明しています。

要は、人気が出すぎてサーバーが悲鳴を上げていたわけです。

この手の制限緩和は地味に見えて、実際にはかなり重要です。

AIは「機能がある」だけでは足りず、ちゃんと使えること が価値だからです。

今回の発表で一番興味深いのは、AnthropicがClaudeを「賢いチャットAI」から、長期記憶を持つ作業エージェント に進化させようとしている点です。

AI活用の本番は、たぶんここです。

1回だけ答えるAIはもう珍しくありません。

でも、何日も、何人も、複数のタスクをまたいで、文脈を維持しながら動くAI は、まだ発展途上です。

その意味で “dreaming” は、派手さはあるけれど中身はかなり実務的な機能です。

名前はロマンチックですが、やっていることはとても現実的。ここが面白いところです。

個人的には、こういう「AIの記憶整理」こそが、今後のエージェントAI競争のカギになるのではないかと思います。

単なるモデルの賢さだけでなく、どれだけうまく文脈を保ち、チームの仕事に馴染めるか。その差が、実務ではかなり効いてくるはずです。

参考: Anthropic's Claude Managed Agents can now "dream," sort of